El context i les conseqüències del desenvolupament vertiginós de la Intel·ligència Artificial (IA) han acaparat la primera sessió de Noves tecnologies i humanisme digital, cicle d'activitats organitzat per Casa Amèrica Catalunya amb la col·laboració de Diplocat. Davant d'un centenar d'alumnes de Batxillerat del Liceu Francès de Barcelona, els experts en la matèria Sofia Trejo i Jordi Vallverdú han abundat en les circumstàncies del “canvi històric fonamental” que l'extensió imparable de l’IA està protagonitzant amb l’absència inquietant d'un embolcall ètic consensuat i pautat. “A l'IA tot és opac. El gran perill és pensar que és un sistema perfecte”, ha advertit Jordi Vallverdú.

24/04/2023 / Barcelona

24/04/2023 / Barcelona

Tecnologia de déus, ments prehistòriques

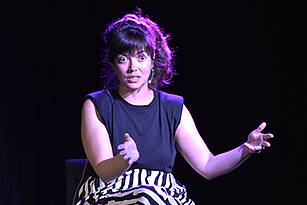

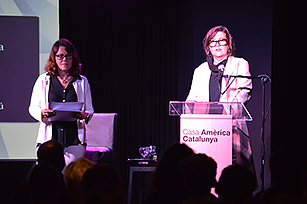

Després de la introducció de la sessió a càrrec de Marta Nin i Laura Foraster, directora de Casa Amèrica Catalunya i secretària general de Diplocat respectivament, la matemàtica mexicana i membre de la xarxa FAIR de recerca feminista sobre Intel·ligència Artificial Sofia Trejo ha iniciat la seva exposició remarcant la necessitat de visibilitzar tots els processos que avui dia fan possible l’IA: Des de l'obtenció de minerals com el cobalt o el liti en zones en conflicte a les xarxes de cables submarins propietats de grans corporacions que transporten el senyal d'Internet arreu del món.

Perspectiva feminista

En aquest context, l'experta ha reivindicat una perspectiva feminista en la generació, la validació i l'ús dels coneixements que alimenten el fenomen de l’IA i aconseguir un canvi en la narrativa existent, que també aquí se’n desfà de les dones i altres col·lectius històricament apartats. "Amb l’IA s'estan revivint sistemàtiques d'opressió i marginació del segle passat que crèiem oblidades", ha assenyalat Trejo. Com a exemple, l’experta ha exposat com als Estats Units s'havien desenvolupat sistemes de reconeixement facial que no funcionaven amb afrodescendents. Les característiques racials d’aquestes persones estaven infrarrepresentades en les bases de dades que alimenten aquests programes.

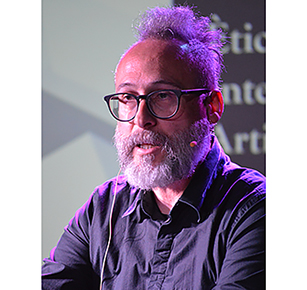

Davant el desenvolupament de l‘IA, “no tenim respostes ni sabem com fer-ho. Som mones amb tecnologia de déus i ments prehistòriques”, afirma amb contundència Jordi Vallverdú, professor d'ICREA Acadèmia especialitzat en Filosofia de la Ciència i la Computació. “No fallen els robots, fallen els sistemes ètics. Aquestes màquines no poden funcionar bé perquè els nostres sistemes ètics no són coherents”, subratlla.

Vallverdú s'ha referit a les primeres passes de l'anomenada justícia predictiva, en què la pròpia IA redacta les resolucions judicials sobre la base d'algorismes que també beuen dels biaixos que es donen a nivell social. “No som justos, mai. Som racistes, sexistes, classistes... Però què vol dir ser neutre?”, s'ha preguntat per afegir: “No som el millor exemple per dissenyar aquestes màquines però sí som útils perquè puguin funcionar”.

Màquines amb sentiments?

I davant la inevitable perpectiva que més aviat que tard l’IA adquireixi la facultat de sentir emocions, Sofia Trejo ha rebutjat abordar aquestes conjectures tot insistint en que cal parlar de les greus circumstancies en es quals es desenvolupa a hores d’ara aquest avenç: “Les tecnologies requerides per a l’IA són les que estan destruint el planeta en nom del progrés i el futur”, denuncia.

“Les màquines no poden computar-ho tot ni ens interessa que ho facin. És inevitable que funcionin malament, no les podem carregar amb dades correctes, les nostres societats són imperfectes. Exigim estàndards a sistemes articials que els humans no complim”, conclou Vallverdú.

Més informació:

Les màquines han de tenir emocions.

Per Anna Cuatrecasas. Diplocat.